As an engineer’s blog, I’d like to share what I’m learning on a daily basis.

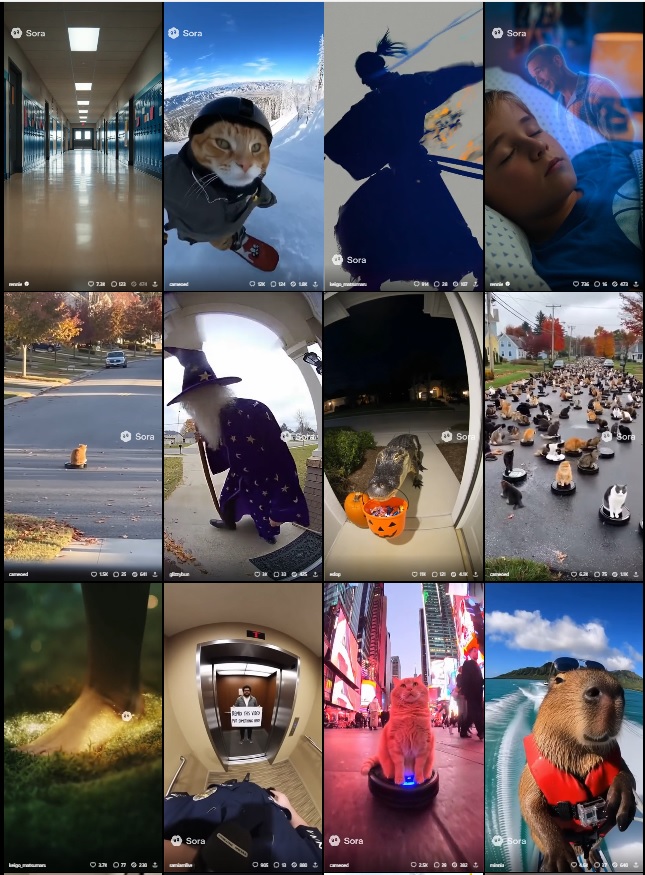

This time, I’ll introduce the popular video generation tool Sora2.

■ From Books to AI──The Evolution of Information Retrieval

In the old days, learning a skill meant frequenting bookstores and libraries. It was an era of poring over thick technical manuals and taking time to understand them. Then the spread of the internet gave birth to a culture of “searching,” and soon “Googling” became commonplace.

And now—

People have entered the era of “asking AI.”

In just a few decades, our relationship with knowledge has evolved this far.

■ How are you all using it?

Many people have tried out AI tools like ChatGPT, image generation AI, and voice synthesis tools. At Dandelions Japan, we’re already leveraging AI for video production for e-commerce sites. By incorporating AI-assisted video generation, we’ve significantly improved production costs and speed. AI is no longer just “research”—it’s become a “tool for the field.” And its adoption will only accelerate from here.

■ The Impact of SORA2’s “Life-Like Videos”

OpenAI’s “SORA2” is a technology that generates realistic videos from text. It has reached a level where it can create footage of people speaking and moving naturally from a single still image.

For example,

・A speech video that does not actually exist

・Unfilmed “dance” scenes

・A video that seems to speak to you, based on photographs of the deceased

──These can be generated with just a few lines of text.

Technologically astonishing, yet simultaneously highlighting issues of copyright and portrait rights. “Even though it’s based only on the person’s image, a video that looks exactly like them is generated.” The boundary between reality and virtuality is becoming more ambiguous than ever before.

■ How to Leverage AI Videos?

When used correctly, this technology opens up endless possibilities for creativity.

・Historical Reenactment in Education and Museum Fields

・Sign language and language learning support

・Streamlining Product Introduction and Advertising Videos

・Artist Virtual Appearance

We are also gradually incorporating AI-generated content into product description videos and promotional footage on our e-commerce site, Dandelions Japan.

■ Three Proposals for Effective Utilization

- Subject to the consent of the individual or creator

AI-generated content must prioritize obtaining consent from the rights holders of the source material. - Disclose the generation of content

By explicitly stating “This video was generated by AI,” we maintain transparency and trustworthiness. - Limited to use for educational, research, and expressive purposes

Not for the purpose of faking, but solely as a “creative assistive technology.”

■ Summary: AI’s value changes based on “who uses it and how”

AI technology is evolving daily. “Hyper-realistic videos” like SORA2 expand creative possibilities while demanding new ethical frameworks for society as a whole. What’s required of us creators and businesses isn’t choosing “not to use” it, but adopting an attitude of designing “how to use it.” Rather than fearing AI, we should strive to understand it correctly and explore ways to utilize it for the future’s benefit.

Well then, stay tuned for the next blog post.